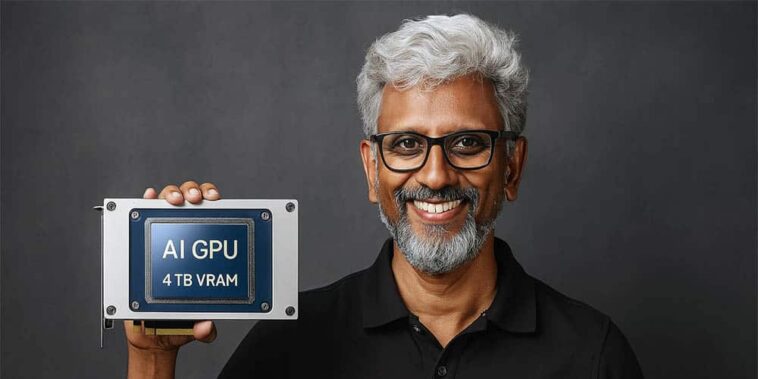

Si vous regardez les nouvelles matérielles et ses principales entreprises depuis quelques années, vous connaissez certains de ses travailleurs les plus pertinents. Raja Koduri pourrait dire qu'il est l'un de ces ingénieurs qui ont été reconnus et, dans ce cas, c'est que c'est quelqu'un qui a été parmi les entreprises les plus importantes du secteur. Après avoir quitté son poste à Intel il y a quelques années, nous devons voir la nouvelle destination de Raja Koduri, car il a été embauché comme conseiller technique de SanDisk, ce qui implique que nous pourrions voir le futur GPU pour IA avec jusqu'à 4 To de VRM.

Raja Koduri a commencé sa carrière professionnelle travaillant pour S3 Graphics en 1996, ce qui est une entreprise américaine qui a créé des puces graphiques. Il n'a pas eu beaucoup de succès si nous prenons en compte qu'il était en concurrence contre NVIDIA, ATI et 3DFX Interactive. Précisément à cause de 2001 Koduri a fini par travailler pour ATI Technologies, la société derrière les graphiques Radeon. Lorsqu'il a été acheté par AMD, l'ingénieur était toujours là et ses contributions étaient nécessaires pour créer plusieurs des architectures GPU que nous connaissons tous. Dans AMD, il était jusqu'en 2009, puis a décidé de travailler pour Apple jusqu'à ce qu'il soit retourné à AMD, cette fois en tant que vice-président du matériel et des logiciels GPU.

Raja Koduri a un nouvel emploi après avoir quitté Intel: il travaillera avec Sandisk pour créer un GPU pour jusqu'à 4 To de VRAM

Excité de s'associer à Sandisk.

Lorsque nous avons commencé le développement de HBM, notre objectif a été d'améliorer la bande passante / WATT et la bande passante / mm ^ 2 (les deux contraintes importantes pour le mobile), tout en conservant une capacité concurrentielle avec les solutions en place. Avec HBF, l'objectif est d'augmenter la mémoire…

– Raja Kodari (@rajaxg)

24 juillet 2025

Ses contributions dans AMD nous ont donné quelques générations de cartes graphiques qui ont été critiquées, telles que la série R9 200 et 300. En 2017, il a décidé de quitter l'entreprise et a été embauché par Intel, où il était en charge de l'architecture ARC, bien qu'il n'ait pas duré longtemps si l'on considère qu'en 2023, il est parti parce qu'il voulait se concentrer sur une startup de l'IA. Maintenant, nous voyons qu'il revient à ses caractéristiques et décide de travailler à nouveau dans l'industrie dans une entreprise connue pour ses SSD et appareils avec de la mémoire flash, Sandisk.

Bien qu'il ne semble pas que le fait qu'un expert en cartes graphiques passe à une entreprise axée sur la mémoire soit logique, tout réside dans quelque chose de très concret, SanDisk HBF, connu sous le nom de mémoire “HBM Killer”. Raja Koduri rejoindra le HBF Technical Advisory Council de Sandisk et nous pouvons voir cela comme une évolution de ce qui était la mémoire HBM lorsqu'il travaillait pour AMD. Comme le dit Koduri dans X, avec HBM, ils se sont concentrés sur l'amélioration de la bande passante par Watt et l'espace tandis qu'avec HBF, ils peuvent considérablement augmenter la capacité avec une bande passante compétitive et pour un prix moins cher.

Un GPU avec HBF a jusqu'à 50 fois plus de mémoire que le Nvidia H100 qu'Elon Musk utilise pour entraîner son Grok

Sachant que l'intelligence artificielle utilisera la plus grande quantité de mémoire VRAM et RAM, si Raja Koduri parvient à créer des puces ou un GPU de l'IA capable d'atteindre ces 4 To de mémoire maximale avec HBF, ce sera un grand saut par rapport à ce que nous avons actuellement. Si nous prenons en compte que la gamme Nvidia arrête des graphiques pour gaming “Only” a 32 Go de VRAM et le H100 pour l'usage à Openai et pour former Grok a 80 Go, ici nous parlons de 50 fois plus de capacité.

Maintenant, nous devons juste attendre pour voir s'ils peuvent vraiment créer des puces pour l'IA avec autant de capacités, car comme nous le savons, de la théorie à la pratique, vous laissez beaucoup. Nous n'avons pas encore vu de carte graphique qui utilise HBF et bien qu'il soit vrai qu'il atteint entre 8 et 16 fois plus de capacité avec la même quantité de modules de mémoire, nous aurions l'inconvénient qu'il aurait une plus grande latence et, dans une certaine mesure, il aurait un impact sur les performances.