Pour nous, le lancement le plus important de GPU concerne gaming généralement, avec NVIDIA RTX, AMD RX ou encore Intel Arc. Mais pour de plus en plus d’entreprises intéressées par l’IA, les GPU IA de NVIDIA et AMD sont en ligne de mire. Les grandes entreprises achèteront celui qui offre les meilleures performances, à condition que son prix soit en conséquence. Après avoir vu comment NVIDIA a anéanti le meilleur d’AMD il y a quelques jours, ceux de l’équipe rouge se sont à nouveau déclarés vainqueurs en utilisant un logiciel optimisé pour l’IA où le MI300X avec vLLM surpasse le H100 en utilisant TensorRT-LLM.

ChatGPT pourrait être considéré comme le fusible qui a déclenché l’immense intérêt suscité par l’IA. C’est pourquoi, si l’on pense au fait qu’un an seulement s’est écoulé depuis son lancement en novembre 2022, il est surprenant de voir à quel point tout a changé. Les entreprises ont abandonné d’autres secteurs d’intérêt et se sont concentrées sur l’intelligence artificielle, qui est aujourd’hui considérée comme l’un des marchés les plus importants du monde technologique. En fait, NVIDIA remporte l’or et a considérablement augmenté ses revenus car ses GPU AI sont les plus rapides.

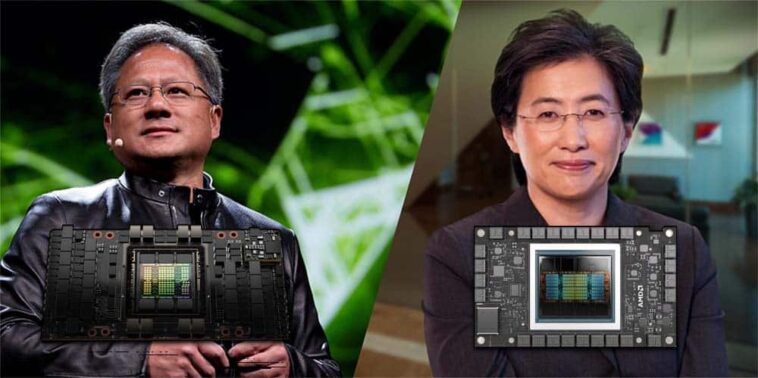

AMD refuse d’accepter la défaite : son GPU MI300X avec vLLM est 30 % plus rapide que le H100 avec TensorRT-LLM

À l’heure actuelle, l’entreprise qui offre les meilleures performances en matière d’IA va gagner un grand nombre de clients de serveurs et de centres de données, en plus de ceux qui utiliseront le matériel pour entraîner leurs propres modèles d’IA. NVIDIA a réussi à être un best-seller dans cet aspect et en fait, il a montré sa poitrine il y a quelques jours en montrant que son H100 était deux fois plus rapide que le MI300X, le GPU le plus puissant d’AMD pour l’IA.

NVIDIA a complètement anéanti AMD en inférence, montrant comment le MI300X ne pouvait absolument rien faire pour rivaliser et accusant également l’entreprise de tricherie. Nous voyons maintenant qu’AMD riposte à nouveau et cette fois, il a effectué des tests en utilisant un logiciel d’IA optimisé. Ici, nous pouvons voir que dans les tests de performances d’inférence utilisant le modèle Llama 2 70B (créé par Meta), la plate-forme avec MI300X atteint plus du double des performances du NVIDIA H100 HGX en vLLM. Si nous passons à l’utilisation de TensorRT-LLM sur NVIDIA et vLLM sur AMD, nous avons à nouveau une autre victoire pour les rouges, cette fois avec 30 % de performances en leur faveur. Enfin, on constate que la latence, mesurée en secondes, est légèrement inférieure à celle de NVIDIA.

AMD accuse NVIDIA d’avoir fait une comparaison injuste des performances de l’IA

Tout comme NVIDIA accusait AMD de tricherie, c’est désormais AMD qui indique que les chiffres publiés par NVIDIA ne sont pas justes pour plusieurs raisons. TensorRT-LLM a été utilisé dans le H100 au lieu du vLLM utilisé par AMD, offrant ainsi à NVIDIA d’excellentes performances dans quelque chose qu’AMD ne peut pas utiliser. Comme l’a indiqué l’entreprise, les tests effectués par NVIDIA n’étaient pas comparables, puisqu’ils utilisaient FP16 pour le GPU Instinct MI300X et FP8 pour le H100.

Ils accusent NVIDIA d’avoir inversé les données de performances publiées par AMD en termes de latence relative et donc, les tests de performances publiés cherchent désormais une comparaison “plus juste” avec son rival. Nous voyons ici que même l’utilisation de TensorRT-LLM sur NVIDIA ne suffit pas pour battre AMD. Malgré cela, nous sommes sûrs qu’ils se battront à nouveau pour savoir qui est le roi de l’IA, car de nombreuses ventes sont en jeu. En revanche, NVIDIA proposera son prochain H200 en 2024, qui utilisera l’architecture Blackwell et sera plus rapide.